La IA está haciendo a las personas más rápidas.

La pregunta es si también las está haciendo menos críticas.

Si Shakespeare existiera hoy, probablemente reescribiría una de sus frases más famosas así:

“¿Usar la IA, o no usarla? He ahí el dilema.”

Porque estamos viviendo un momento extraño en la historia: la IA nos está haciendo a las personas muchísimo más productivas y, al mismo tiempo, está creando nuevos riesgos alrededor de la dependencia, la pérdida de pensamiento crítico y la pasividad intelectual.

Estudios de Harvard, MIT, Microsoft Research y otros empiezan a mostrar una realidad compleja. Por un lado, la IA claramente mejora la eficiencia y acelera el trabajo operativo. Por otro, los investigadores ya empiezan a advertir sobre el “copiloto pasivo”: la tendencia a dejar de cuestionar respuestas simplemente porque una máquina las entregó con seguridad.

Entonces, la pregunta ya no es si deberíamos usar IA.

La verdadera pregunta es: ¿cómo usamos la IA sin delegarle nuestro criterio?

Quiero compartirles dos frameworks que me parecieron especialmente útiles para responder esa pregunta.

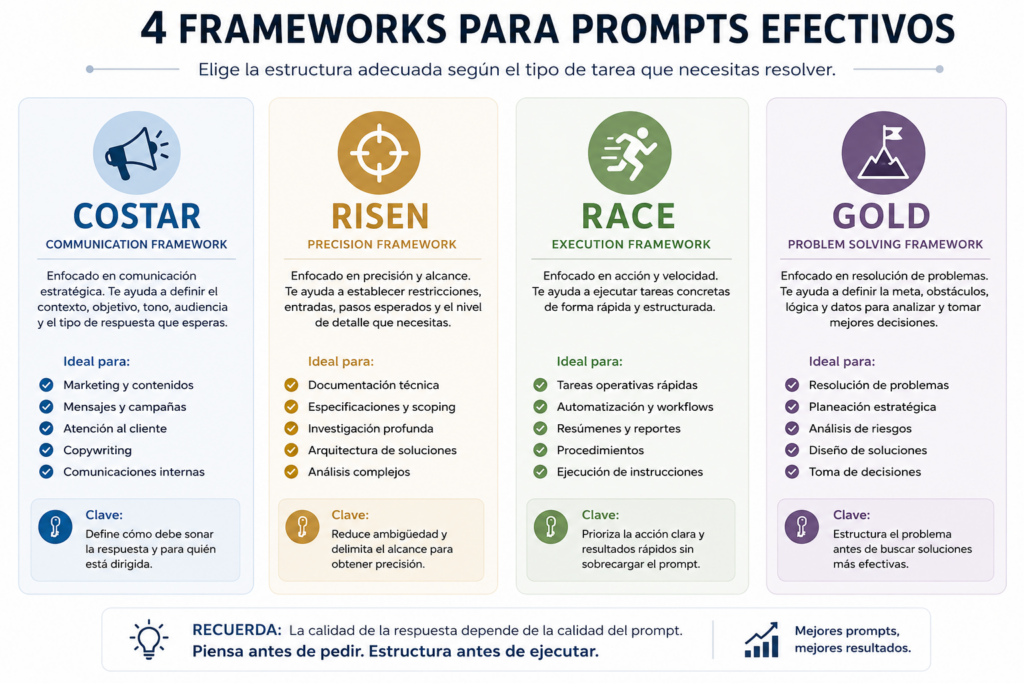

El primero está enfocado en algo fundamental: aprender a estructurar mejor nuestras instrucciones. Porque la IA no reemplaza el pensamiento; lo amplifica. La calidad de la respuesta dependerá directamente de la claridad, profundidad y precisión de lo que le entreguemos.

Si el contexto es pobre, ambiguo o superficial, la IA intentará completar los vacíos por su cuenta. Y ahí es donde empiezan muchos de los problemas: respuestas convincentes, pero construidas sobre supuestos débiles o información incompleta.

Por eso, en esta primera parte veremos cuatro estructuras extremadamente útiles dependiendo del tipo de tarea que necesites resolver: comunicación, ejecución rápida, resolución de problemas o análisis técnico profundo.

Framework 1: Estructura mejor el prompt.

COSTAR — Comunicación estratégica y contenido persuasivo

COSTAR funciona muy bien cuando el objetivo principal es controlar el tono, la narrativa y la calidad comunicativa de la respuesta. Este framework ayuda a estructurar prompts orientados a marketing, branding, ventas, contenido educativo y atención al cliente.

Su fortaleza está en que obliga a definir no solo qué quieres, sino también cómo debe sonar, para quién está dirigido y qué tipo de respuesta esperas.

Cuándo usarlo

- Campañas de marketing

- Posts de LinkedIn

- Correos comerciales

- Atención al cliente

- Copywriting

- Contenido educativo

Ejemplo de instrucción

#Context:

Eres parte de una empresa SaaS B2B especializada en automatización.

Objective:

Escribe un post de LinkedIn sobre pensamiento crítico e IA.

#Style:

Profesional pero conversacional.

#Tone:

Reflexivo y ligeramente provocador.

#Audience:

Arquitectos de soluciones y líderes tecnológicos.

#Response:

Incluye una introducción fuerte, un ejemplo práctico y un cierre memorable.

RISEN — Restricciones, precisión y alcance técnico

RISEN es útil para tareas donde la precisión importa más que la creatividad. El enfoque está en limitar ambigüedad y reducir interpretaciones abiertas del modelo.

Es ideal para documentación técnica, investigación profunda, arquitectura de soluciones, generación de especificaciones o tareas complejas donde el contexto debe estar cuidadosamente delimitado.

Cuándo usarlo

- Documentación técnica

- Scoping

- Investigación profunda

- Arquitectura de software

- Requerimientos funcionales

- Análisis complejos

Ejemplo de instrucción

Role:

Actúa como arquitecto de integración especializado en HubSpot y Salesforce.

Input:

Necesitamos diseñar una sincronización bidireccional de contactos.

Steps:

1. Identifica riesgos.

2. Define arquitectura.

3. Explica dependencias.

4. Sugiere middleware.

Expectation:

La respuesta debe ser altamente técnica y estructurada.

Narrowing:

No incluyas opciones que requieran Operations Hub Enterprise.

RACE — Ejecución rápida y tareas operativas

RACE está diseñado para velocidad y claridad operacional. Funciona mejor cuando necesitas que la IA ejecute tareas concretas sin demasiada exploración conceptual.

Es muy útil para automatización diaria, generación rápida de contenido estructurado y workflows repetitivos.

Cuándo usarlo

- Tareas rápidas

- Automatización operativa

- Resúmenes

- Procedimientos

- Transformación de texto

- Ejecución procedural

Ejemplo de instrucción

Role:

Actúa como project manager técnico.

Action:

Resume esta reunión en bullets accionables.

Context:

La reunión fue sobre una migración de Salesforce a HubSpot.

Execute:

Genera:

- decisiones tomadas

- riesgos

- próximos pasos

- responsables

GOLD — Resolución de problemas y pensamiento estratégico

GOLD es uno de los frameworks más útiles para problemas complejos porque obliga a estructurar el razonamiento antes de generar respuestas.

Ayuda muchísimo en planificación estratégica, análisis de riesgos, troubleshooting y toma de decisiones donde existen múltiples variables u obstáculos.

Cuándo usarlo

- Resolución de problemas

- Planeación estratégica

- Análisis de riesgos

- Troubleshooting

- Diseño de soluciones

- Toma de decisiones

Ejemplo de instrucción

Goal:

Reducir duplicados entre HubSpot y Salesforce.

Obstacles:

Los sistemas tienen IDs inconsistentes y múltiples fuentes de verdad.

Logic:

Analiza opciones considerando escalabilidad y mantenimiento.

Data:

- 500k contactos

- sincronización bidireccional

- múltiples pipelines

- integración existente con middleware

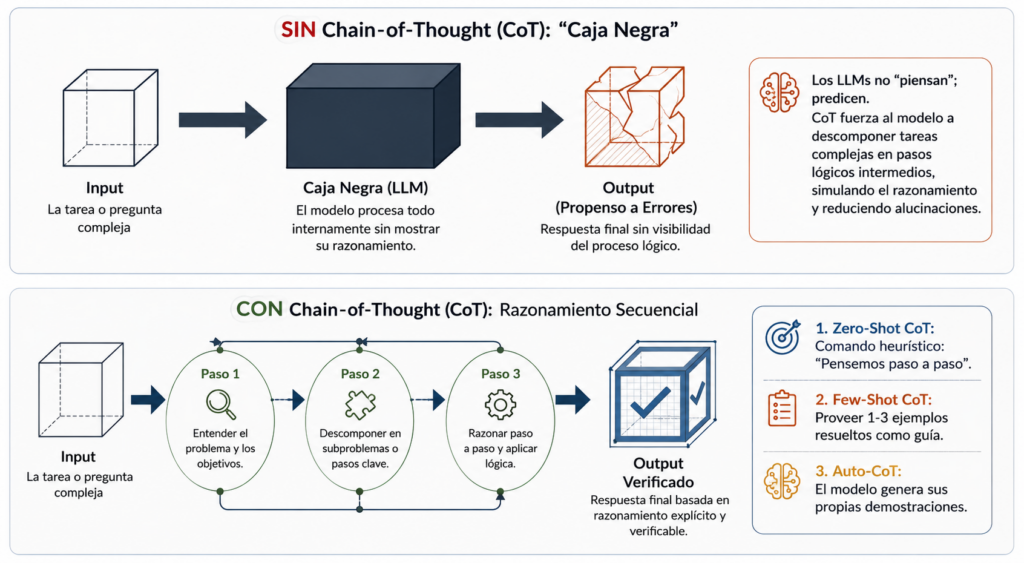

Framework 2: Chain of Thought — dividir antes de responder

Ahora, ¿qué pasa cuando tenemos una tarea demasiado grande y necesitamos ayuda para resolverla?

Aquí aparece un problema muy común: escribimos un prompt enorme, recibimos una respuesta enorme… y luego no tenemos una forma clara de evaluarla. Hay demasiado contenido, demasiadas suposiciones y demasiadas decisiones mezcladas en una sola respuesta.

Ahí es donde entra Chain of Thought.

Primero, tenemos que aclarar algo importante: los LLMs no “piensan” como una persona. Predicen la siguiente respuesta más probable con base en patrones, contexto e instrucciones.

Entonces, cuando les damos una tarea compleja y solo pedimos “dame la respuesta final”, estamos confiando en una predicción sin ver cómo fue construida.

Con Chain of Thought, no buscamos que la IA “piense” de verdad. Lo que hacemos es pedirle que descomponga una tarea compleja en pasos lógicos, visibles y evaluables. Esto ayuda a reducir errores, detectar supuestos débiles y evitar respuestas que suenan bien, pero no resisten una revisión cuidadosa.

La diferencia es enorme.

Ejemplo simple

En vez de pedir:

Crea una estrategia de implementación de HubSpot para este cliente.

Antes de darme la estrategia final, divide el problema en pasos:

1. Identifica los objetivos del cliente.

2. Lista los sistemas involucrados.

3. Detecta dependencias y riesgos.

4. Define supuestos.

5. Propón una estrategia por fases.

6. Explica qué partes requieren validación antes de avanzar.

Después de eso, genera la recomendación final.

El segundo prompt no solo produce una mejor respuesta. También nos permite auditar cómo llegó a esa respuesta.

Ejemplo aplicado a evaluación

También podemos usar Chain of Thought para revisar una respuesta de la IA:

Evalúa esta respuesta antes de mejorarla:

1. ¿Qué supuestos está haciendo?

2. ¿Qué partes están poco sustentadas?

3. ¿Qué información falta?

4. ¿Dónde podría estar alucinando?

5. ¿Qué debería validarse con una fuente externa?

6. Luego genera una versión corregida.

Este enfoque cambia la relación con la IA.

Ya no le estamos diciendo: “dame una respuesta”.

Le estamos diciendo: “ayúdame a construir, revisar y mejorar una respuesta con criterio”.

Y ahí está la diferencia entre usar IA como piloto automático y usarla como una herramienta real de pensamiento.

Si llegaste hasta aquí 10/10, espero que te sirva como a mi.